„Noi decidem când și cum să folosim instrumentele AI în munca noastră.” —

Un psiholog și un antropolog se gândesc la riscurile epistemice pe care AI le-ar prezenta pentru știință.

Mărește / Preocupările actuale cu privire la AI tind să se concentreze pe erorile sale evidente. Dar psihologul Molly Crockett și antropologul Lisa Messeri susțin că AI prezintă și riscuri epistemice potențiale pe termen lung pentru practica științei.

Just_Super/E+ prin Getty

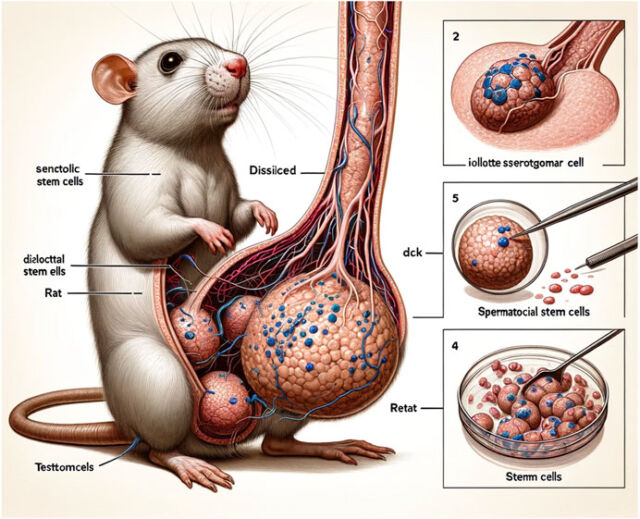

Luna trecută, am fost martori senzația virală a mai multor cifre generate de IA extrem de proaste publicate în a articol revizuit de colegi în Frontiers, o revistă științifică de renume. Oamenii de știință de pe rețelele de socializare au exprimat în părți egale șoc și ridicol la imagini, dintre care una prezenta un șobolan cu organe genitale grotesc de mari și bizare.

În calitate de Beth Mole, reporter senior de sănătate Ars raportatPrivind mai atent, a scos la iveală mai multe defecte, inclusiv etichetele „dissilced”, „celule stem”, „iollotte sserotgomar” și „dck”. Figura 2 a fost mai puțin grafică, dar la fel de alterată, plină de texte prostii și imagini derutante. Idem pentru Figura 3, un colaj de imagini circulare mici adnotate dens cu farfurie.

Hârtia a fost retrasă de atunci, dar acea imagine uluitoare a penisului de șobolan va rămâne imprimată de neșters în conștiința noastră colectivă. Incidentul întărește o preocupare tot mai mare că utilizarea tot mai mare a IA va face cercetările științifice publicate mai puțin demne de încredere, chiar dacă crește productivitatea. În timp ce proliferarea erorilor este o preocupare valabilă, în special în primele zile ale instrumentelor AI precum ChatGPT, doi cercetători susțin că o nouă perspectivă publicat în revista Nature că AI prezintă, de asemenea, potențiale riscuri epistemice pe termen lung pentru practica științei.

Molly Crockett este psiholog la Universitatea Princeton, care colaborează în mod obișnuit cu cercetători din alte discipline în cercetarea sa asupra modului în care oamenii învață și iau decizii în situații sociale. Coautorul ei, Lisa Messerieste un antropolog la Universitatea Yale ale cărui cercetări se concentrează pe studiile științifice și tehnologice (STS), analizând normele și consecințele comunităților științifice și tehnologice pe măsură ce creează noi domenii de cunoaștere și invenție, cum ar fi AI.

Impulsul inițial pentru noua lor lucrare a fost a Studiu 2019 publicat în Proceedings of the National Academy of Sciences susținând că cercetătorii ar putea folosi învățarea automată pentru a prezice replicabilitatea studiilor bazate doar pe o analiză a textelor lor. Crockett și Messeri au scris împreună o scrisoare editorului în care contestă această afirmație, dar la scurt timp după aceea, mai multe studii a apărut, pretinzând că marile modele de limbaj ar putea înlocui oameni în cercetarea psihologică. Perechea și-a dat seama că aceasta este o problemă mult mai mare și a decis să lucreze împreună la o analiză aprofundată a modului în care oamenii de știință propun să utilizeze instrumentele AI pe tot parcursul academic.

Au venit cu patru categorii de viziuni pentru AI în știință. Primul este AI ca Oracle, în care astfel de instrumente pot ajuta cercetătorii să caute, să evalueze și să sintetizeze vasta literatură științifică, precum și să genereze noi ipoteze. Al doilea este AI ca surogat, în care instrumentele AI generează puncte de date surogat, poate chiar înlocuind subiecții umani. Al treilea este AI ca Quant. În era datelor mari, instrumentele AI pot depăși limitele intelectului uman prin analizarea unor seturi de date vaste și complexe. În cele din urmă, există AI ca arbitru, bazându-se pe astfel de instrumente pentru a evalua mai eficient meritul științific și replicabilitatea lucrărilor prezentate, precum și pentru a evalua propunerile de finanțare.

Fiecare categorie aduce beneficii incontestabile sub forma productivității crescute – dar și anumite riscuri. Crockett și Messeri avertizează în mod deosebit față de trei „iluzii de înțelegere” distincte care pot apărea din dependența excesivă de instrumentele AI, care ne pot exploata limitările cognitive. De exemplu, un om de știință poate folosi un instrument AI pentru a modela un anumit fenomen și poate crede că, prin urmare, înțeleg acel fenomen mai mult decât îl fac de fapt (o iluzie de profunzime explicativă). Sau o echipă ar putea crede că explorează toate ipotezele testabile atunci când explorează cu adevărat doar acele ipoteze care sunt testabile folosind AI (o iluzie de amploare exploratorie). În cele din urmă, există iluzia obiectivității: convingerea că instrumentele AI sunt cu adevărat obiective și nu au părtiniri sau un punct de vedere, spre deosebire de oameni.

Mărește / Această imagine generată de AI, condusă de erori, publicată în jurnalul Frontiers, ar trebui să arate celule stem spermatogoniale, izolate, purificate și cultivate din testiculele de șobolan.

Sloganul ziarului este „a produce mai mult în timp ce înțelege mai puțin”, iar acesta este mesajul central pe care perechea speră să îl transmită. „Scopul cunoștințelor științifice este de a înțelege lumea și toată complexitatea, diversitatea și extinderea ei”, a spus Messeri pentru Ars. „Preocuparea noastră este că, deși am putea scrie din ce în ce mai multe lucrări, deoarece sunt constrânse de ceea ce AI poate și nu poate face, în cele din urmă, într-adevăr, punem doar întrebări și producem o mulțime de lucrări care sunt în capabilitățile AI.”

Nici Crockett, nici Messeri nu se opun orice utilizarea instrumentelor AI de către oamenii de știință. „Este cu adevărat util în cercetarea mea și mă aștept să îl folosesc în continuare în cercetarea mea”, a spus Crockett pentru Ars. Mai degrabă, ei adoptă o abordare mai agnostică. „Nu este pentru mine și Molly să spunem: „Asta este ceea ce ar trebui sau nu ar trebui să fie IA”, a spus Messeri. „În schimb, facem observații despre modul în care AI este poziționată în prezent și apoi luăm în considerare domeniul de conversație pe care ar trebui să o avem despre riscurile asociate.”

Ars a vorbit pe larg cu Crockett și Messeri pentru a afla mai multe.