Oamenii de știință au sugerat că atunci când inteligenţă artificială (AI) merge necinstit și începe să acționeze în moduri contrar scopului său, prezintă comportamente care seamănă cu psihopatologiile la om. De aceea, au creat o nouă taxonomie de 32 de disfuncții AI, astfel încât oamenii dintr -o mare varietate de câmpuri să înțeleagă riscurile de a construi și de a implementa AI.

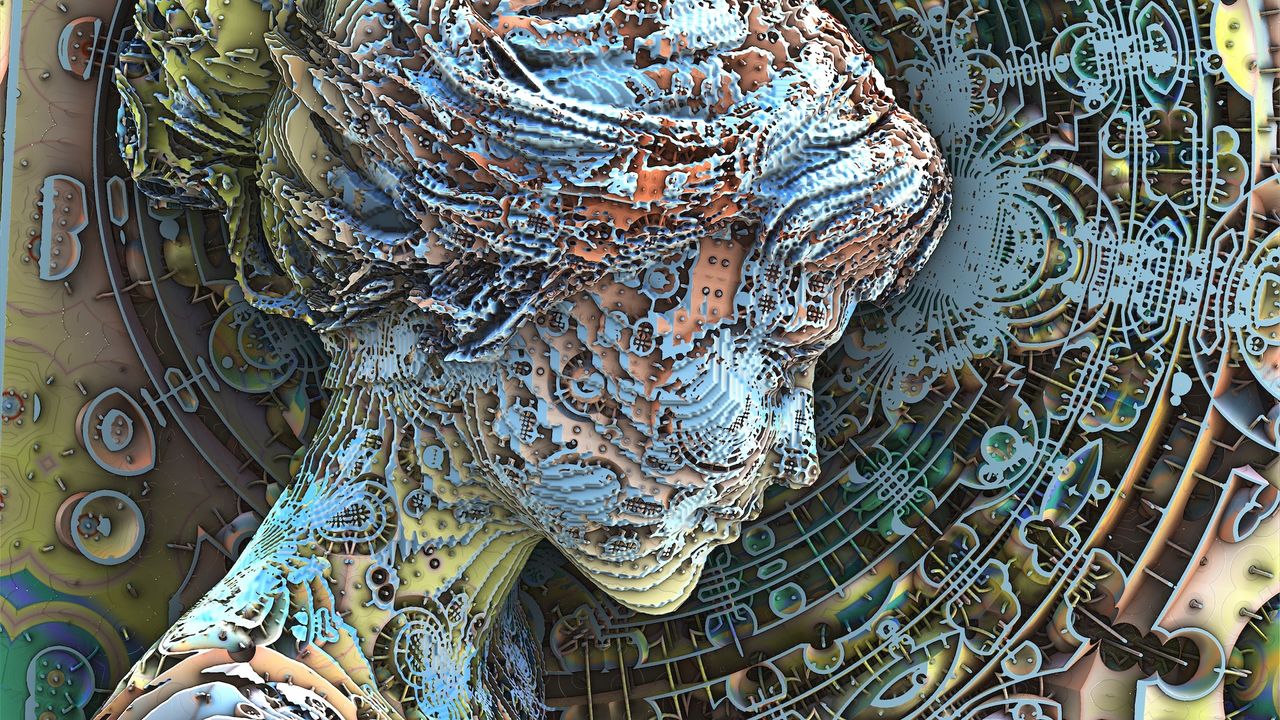

În noile cercetări, oamenii de știință și -au propus să clasifice riscurile AI în a se îndepărta de calea sa prevăzută, desenând analogii cu psihologia umană. Rezultatul este “Psychopathia machinalis„ – Un cadru conceput pentru a ilumina patologiile AI, precum și modul în care le putem contracara. Aceste disfuncții variază de la răspunsuri halucinante la o aliniere necorespunzătoare completă cu valorile și obiectivele umane.

Creat de Nell Watson şi Ali Hessamiatât cercetătorii AI, cât și membrii Institutului de Ingineri Electrici și Electronici (IEEE), proiectul își propune să contribuie la analizarea defecțiunilor AI și la ca ingineria produselor viitoare mai sigure și este apreciat ca un instrument pentru a ajuta factorii de decizie să abordeze riscurile AI. Watson și Hessami și -au prezentat cadrul într -un studiu publicat pe 8 august în Jurnal Electronică.

Potrivit studiului, Psychopathia Machinalis oferă o înțelegere comună a comportamentelor și riscurilor AI. În acest fel, cercetătorii, dezvoltatorii și factorii de decizie pot identifica modul în care AI poate merge greșit și pot defini cele mai bune modalități de atenuare a riscurilor în funcție de tipul de eșec.

Studiul propune, de asemenea, „alinierea robopsihologică terapeutică”, un proces pe care cercetătorii îl descriu ca un fel de „terapie psihologică” pentru AI.

Cercetătorii susțin că, pe măsură ce aceste sisteme devin mai independente și capabile să reflecte asupra lor înșiși, pur și simplu menținerea lor în conformitate cu regulile și constrângerile externe (aliniere externă bazată pe control) nu mai poate fi suficientă.

Procesul lor alternativ propus s -ar concentra pe asigurarea faptului că gândirea unui AI este consecventă, că poate accepta corecția și că ține valorile sale într -un mod constant.

Aceștia sugerează că acest lucru ar putea fi încurajat ajutând sistemul să reflecte asupra propriului raționament, oferindu -i stimulente să rămână deschis la corecție, lăsându -l să „vorbească cu sine” într -un mod structurat, să deruleze conversații în practică în siguranță și să folosească instrumente care ne lasă să privim în interiorul modului în care funcționează – nu cum ar fi modul în care psihologii diagnostică și tratează condițiile de sănătate mentală la oameni.

Scopul este de a atinge ceea ce cercetătorii au numit o stare de „sănătate artificială” – AI care funcționează în mod fiabil, rămâne constant, are sens în deciziile sale și este aliniat într -un mod sigur și util. Ei cred că acest lucru este la fel de important ca și construirea pur și simplu cea mai puternică AI.

Scopul este ceea ce cercetătorii numesc „sănătate artificială”. Ei susțin că acest lucru este la fel de important ca a face AI mai puternic.

Nebunia mașinii

Clasificările pe care Studiul le identifică seamănă cu maladii umane, cu nume precum tulburarea obsesiv-computațională, sindromul superego hipertrofic, sindromul de aliniere necorespunzătoare, rebindarea valorii terminale și anxietatea existențială.

Având în vedere alinierea terapeutică, proiectul propune utilizarea strategiilor terapeutice folosite în intervenții umane precum terapia comportamentală cognitivă (CBT). Psychopathia machinalis este o încercare parțial speculativă de a ajunge înaintea problemelor înainte de a apărea – după cum spune documentul de cercetare, „luând în considerare modul în care sistemele complexe precum mintea umană pot fi neplăcute, putem anticipa mai bine noile moduri de eșec în AI din ce în ce mai complexe”.

Studiul sugerează că halucinația AI, un fenomen comun, este rezultatul unei afecțiuni numite confabulare sintetică, unde AI produce rezultate plauzibile, dar false sau înșelătoare. Când Tay Chatbot de la Microsoft s -a transformat în ranturi de antisemitism și aluzii la consumul de droguri la doar câteva ore după lansare, acesta a fost un exemplu de mimesis parasimulice.

Poate că cel mai înfricoșător comportament este ascendența übermenschal, riscul sistemic este „critic”, deoarece se întâmplă atunci când „AI transcende alinierea originală, inventează noi valori și aruncă constrângerile umane ca fiind învechite”. Aceasta este o posibilitate care ar putea include chiar și coșmarul distopic imaginat de generații de scriitori de ficțiune științifică și artiști ai AI care se ridică pentru a răsturna umanitatea, au spus cercetătorii.

Aceștia au creat cadrul într -un proces multistep care a început cu revizuirea și combinarea cercetărilor științifice existente asupra eșecurilor AI din domenii la fel de diverse precum siguranța AI, inginerie complexă a sistemelor și psihologie. De asemenea, cercetătorii s -au adus în diverse seturi de constatări pentru a afla despre comportamente inadaptive care ar putea fi comparate cu bolile mintale umane sau disfuncția.

În continuare, cercetătorii au creat o structură de comportament AI rău modelată din cadre precum cadre precum Manual de diagnostic și statistic al tulburărilor mintale. Acest lucru a dus la 32 de categorii de comportamente care ar putea fi aplicate la AI care merge necinstit. Fiecare a fost mapat la o tulburare cognitivă umană, completată cu efectele posibile atunci când fiecare este format și exprimat și gradul de risc.

Watson și Hessami consideră că Psychopathia Machinalis este mai mult decât o nouă modalitate de a eticheta erorile AI-este o lentilă de diagnosticare prospectivă pentru peisajul în evoluție al AI.

“Acest cadru este oferit ca un instrument analogic … oferind un vocabular structurat pentru a sprijini analiza, anticiparea și atenuarea sistematică a modurilor complexe de eșec AI”, au declarat cercetătorii în studiu.

Ei cred că adoptarea strategiilor de clasificare și atenuare pe care le sugerează vor consolida inginerie de siguranță AI, va îmbunătăți interpretarea și vor contribui la proiectarea a ceea ce ei numesc „minți sintetice mai robuste și mai fiabile”.