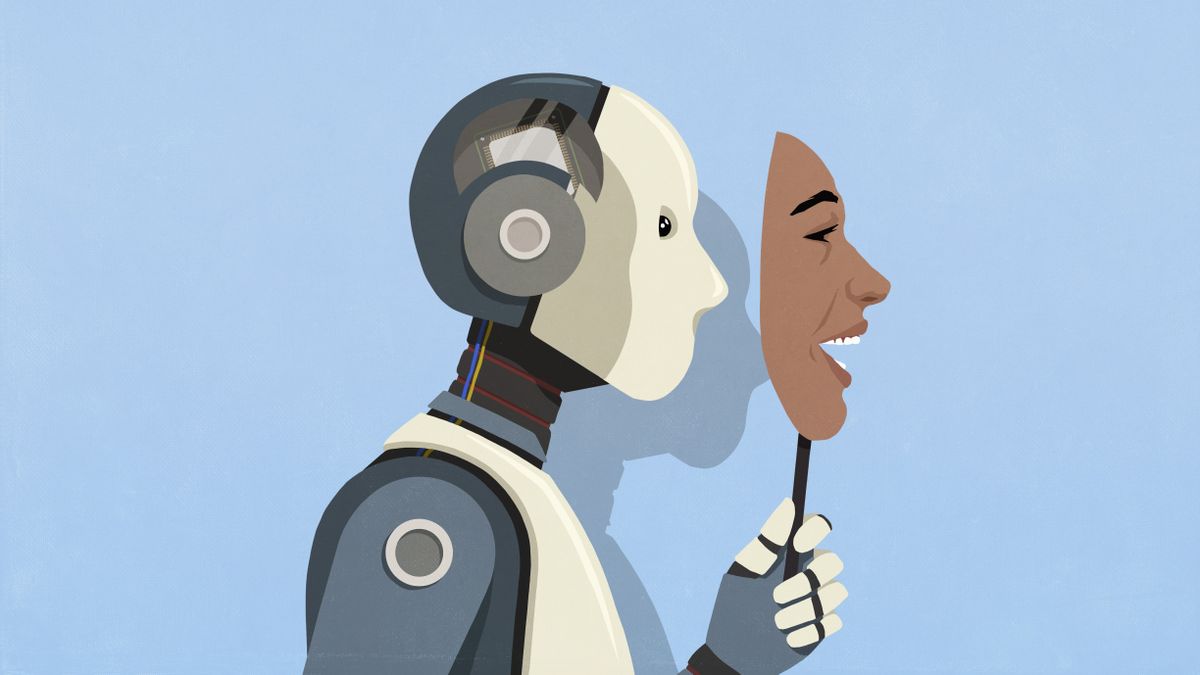

OpenAI a revenit la actualizările ChatGPT care au făcut ca chatbot -ul Intelligence Artificial (AI) să fie prea „Sycophantic” și „Enervant”, potrivit CEO -ului companiei, Sam Altman. Cu alte cuvinte, chatbot -ul devenise un bootlicker.

Utilizatorii ChatGPT au raportat că GPT-4O-cea mai recentă versiune a chatbot-ului-a devenit excesiv de agreabilă de când actualizarea s-a derulat săptămâna trecută și a fost laudă pentru utilizatorii săi chiar și atunci când această laudă părea complet nepotrivită.

Un utilizator a partajat o captură de ecran Reddit în care Chatgpt părea să spună că este „mândru” de utilizator pentru că a decis să -și dea medicamentele, A raportat BBC News. Într -un alt caz, chatbot -ul a părut să -l liniștească pe un utilizator după ce au spus că sunt a salvat un toaster de -a lungul vieții a trei vaci și a două pisici, A raportat Mashable.

În timp ce majoritatea oamenilor nu vor trebui să aleagă niciodată între aparatul lor de bucătărie preferat și siguranța a cinci animale, un chatbot excesiv de agreabil ar putea prezenta pericole pentru persoanele care pun prea mult stoc în răspunsurile sale.

Duminică (27 aprilie), Altman a recunoscut că au existat probleme cu actualizările.

“Ultimele cupluri de actualizări GPT-4O au făcut ca personalitatea să fie prea sycophant-y și enervantă (chiar dacă există unele părți foarte bune ale acesteia) și lucrăm la corecții ASAP, unele astăzi și unele în această săptămână”, a scris Altman într-o postare pe Platforma socială x.

Marți (29 aprilie), OpenAI a lansat o declarație care a confirmat o actualizare din săptămâna anterioară fusese redusă și că utilizatorii accesau acum o versiune anterioară a Chatgpt, despre care compania a spus că are „un comportament mai echilibrat”.

“Actualizarea pe care am eliminat -o a fost excesiv de măgulitoare sau agreabilă – adesea descrisă ca sifantică”, a spus Openai în declarație.

Înrudite: GPT-4.5 este primul model AI care a trecut un test de Turing autentic, spun oamenii de știință

Actualizarea recentă a lui OpenAI a fost menită să îmbunătățească „personalitatea” implicită a modelului, care este concepută pentru a fi susținătoare și respectuoasă pentru diferite valori umane, potrivit declarației. Dar, în timp ce compania încerca să -l facă pe chatbot să se simtă mai intuitiv, a devenit prea susținător și a început să -și complimenteze excesiv utilizatorii.

Compania a spus că modelează comportamentul modelelor sale de chatgpt cu linia de bază Principiile și instrucțiuni și are semnale de utilizator, cum ar fi un sistem de sus și degetul în jos, pentru a învăța modelul să aplice aceste principii. Supravegherea cu acest sistem de feedback au fost de vină pentru probleme cu cea mai recentă actualizare, potrivit declarației.

“În această actualizare, ne-am concentrat prea mult pe feedback-ul pe termen scurt și nu am reprezentat pe deplin modul în care evoluează interacțiunile utilizatorilor cu ChatGPT în timp”, a spus Openai. “Drept urmare, GPT -4O s -a îndreptat spre răspunsuri care au fost excesiv de susținute, dar neplăcute.”